本帖最后由 黑崎一护 于 2018-8-27 14:14 编辑

本文转载于https://www.cnblogs.com/geekvc/p/6657369.html 1 COCO简介 该数据集主要有的特点如下: - (1)Object segmentation

- (2)Recognition in Context

- (3)Multiple objects per image

- (4)More than 300,000 images

- (5)More than 2 Million instances

- (6)80 object categories

- (7)5 captions per image

- (8)Keypoints on 100,000 people

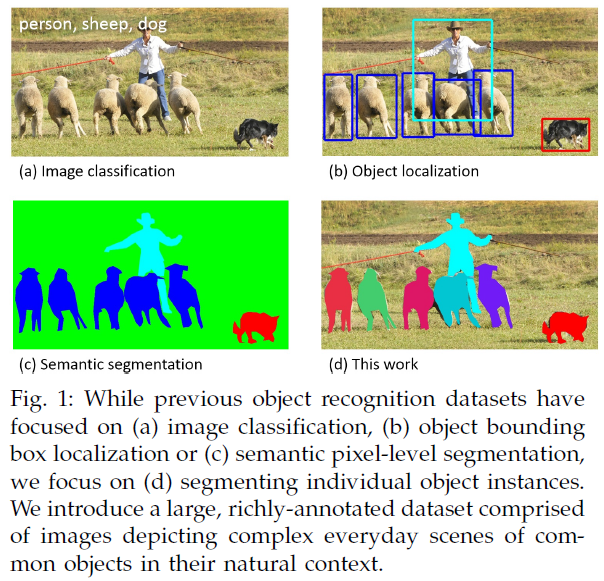

该数据集主要解决3个问题:目标检测,目标之间的上下文关系,目标的2维上的精确定位。数据集的对比示意图:

图1-1

2 数据集分类图片分类:

分类需要二进制的标签来确定目标是否在图像中。早期数据集主要是位于空白背景下的单一目标,如MNIST手写数据库,COIL household objects。在机器学习领域的著名数据集有CIFAR-10 and CIFAR-100,在32*32影像上分别提供10和100类。最近最著名的分类数据集即ImageNet,22,000类,每类500-1000影像。 目标检测: 通过bounding box确定目标位置,主要用于人脸检测与行人检测,数据集如Caltech Pedestrian Dataset包含350,000个bounding box标签。PASCAL VOC数据包括20个目标超过11,000图像,超过27,000目标bounding box。ImageNet数据下获取的目标检测数据集有200类,400,000张图像,350,000个边界框。由于一些目标之间有着强烈的关系,在特定场景下检测某种目标不确定是否有意义,因此精确的位置信息比边界框更加重要。 语义场景标注:

这类问题需要pixel级别的标签,其中个别目标很难定义,如街道和草地。数据集主要包括室内场景和室外场景的,一些数据集包括深度信息。其中,SUN dataset包括908个场景类,3,819个常规目标类(person, chair, car)和语义场景类(wall, sky, floor),每类的数目具有较大的差别(这点COCO数据对其进行了改进,保证每一类数据足够)。

图2-1

其他视觉数据集 一些数据集如Middlebury datasets,包含立体相对,多视角立体像对和光流;同时还有Berkeley Segmentation Data Set (BSDS500),可以评价语义分割和边缘检测算法。 该数据集标记流程如下:

图3-1

COCO数据集有91类,虽然比ImageNet和SUN类别少,但是每一类的图像多,这有利于获得更多的每类中位于某种特定场景的能力,对比PASCAL VOC,其有更多类和图像。 COCO数据集分两部分发布,前部分于2014年发布,后部分于2015年发布。 2014年版本: 82,783 training, 40,504 validation, and 40,775 testing images,有270k的segmented people和886k的 segmented object; 2015年版本: 165,482 train, 81,208 val, and 81,434 test images。 其性能对比和一些例子: 图3-2

图3-3

图3-4

本篇文章主要介绍了MS COCO数据集,分别介绍了三个部分:COCO介绍,数据集分类和COCO展示。

|